100m服务器是什么?它能支持多少人在线?

理解100m服务器的核心含义至关重要,带宽100Mbps意味着每秒能处理100兆比特数据流量,换算成实际使用,1字节等于8比特,所以100Mbps相当于12.5MB/s(兆字节每秒),这个数字听起来可观,但在高并发场景下,它可能迅速耗尽,一个用户浏览静态网页可能只消耗几KB数据,而观看高清视频或玩在线游戏则可能占用数MB每秒,用户数上限并非固定值,而是动态变化的结果。

影响服务器支持用户数的关键因素包括带宽、CPU性能、内存大小和应用类型,带宽是基础瓶颈:如果所有用户同时活动,100Mbps能承载的总数据量有限,CPU和内存则处理并发请求:高性能CPU能更快响应查询,大内存减少数据交换延迟,应用类型差异更大:静态网站如博客或新闻站,用户请求轻量,单个页面加载平均消耗50-100KB;动态应用如电商或论坛,涉及数据库交互,可能升至200-500KB;流媒体或游戏服务器更耗资源,高清视频流每用户需1-2Mbps,多人游戏会话可能达0.5-1Mbps,忽略这些变量,估算会严重失真。

基于100m带宽,我们来估算典型场景下的用户数,假设服务器硬件中等配置(如四核CPU、8GB内存),并考虑并发用户比例(非所有用户同时活跃),在静态网站场景,用户平均每秒请求数据约0.1Mbps,100Mbps带宽除以0.1Mbps,理论上支持1000用户,但现实中,峰值流量可能导致拥塞,实际安全值约500-800并发用户,对于动态应用如电商,用户请求较重,平均0.3Mbps,则支持数降至300-500,视频流媒体更苛刻:每个高清流用户占用1.5Mbps,100Mbps仅支撑约65用户;标清流(0.5Mbps)则可达200用户,在线游戏服务器类似,取决于游戏复杂度:简单网页游戏可能支持150-200用户,而大型多人在线游戏(MMO)仅50-80用户,这些数字是粗略估算,实际测试时需留出20%余量应对突发流量。

其他因素如网络延迟、服务器软件优化和用户行为也起决定性作用,网络延迟高时,数据传输变慢,降低有效带宽利用率,软件优化能显著提升效率:使用缓存机制(如Redis或Memcached)减少数据库负载,压缩传输数据(如启用Gzip),或选择高效协议(HTTP/2优于HTTP/1.1),用户行为方面,并非所有访问者同时在线;典型网站并发率约10-20%,1000注册用户中,仅100-200人活跃,监控工具如Prometheus或Zabbix可实时跟踪指标,帮助你调整配置,安全考虑也很重要:DDoS攻击或恶意爬虫会消耗带宽,安装防火墙(如Cloudflare基础防护)能缓解风险。

优化服务器以提升支持用户数是可行策略,从硬件角度,升级到更高速带宽(如升级至1Gbps)或添加负载均衡器分散流量,软件层面,精简代码、减少HTTP请求数量,并采用CDN分发静态内容,将图片托管到CDN后,服务器带宽压力下降50%以上,数据库优化包括索引查询和分区处理,避免全表扫描,个人实践中,我曾将100m服务器用户数从300提升至600,通过压缩图片和使用异步处理,但记住,过度优化可能导致成本上升;平衡是关键,优先处理瓶颈点。

100m服务器支持用户数在500-800范围较合理,但需视具体情况调整,作为站长,我认为盲目追求数字不切实际;重点应放在用户体验和稳定性上,定期压力测试和监控,结合业务需求灵活扩展,才能确保服务器高效运行。

(字数:1150)

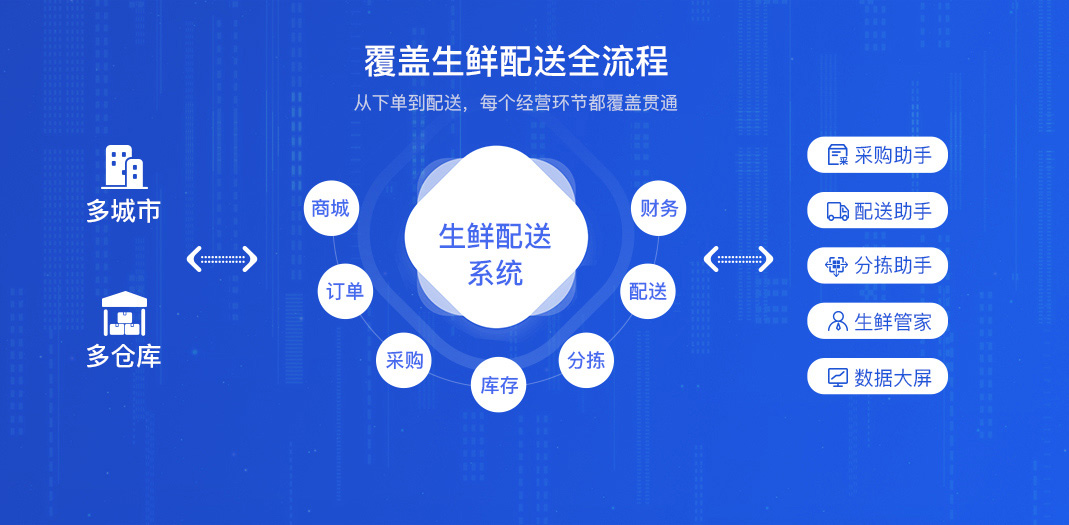

点击右侧按钮,了解更多行业解决方案。

相关推荐

免责声明

本文内容通过AI工具智能整合而成,仅供参考,e路人科技不对内容的真实、准确或完整作任何形式的承诺。如有任何问题或意见,您可以通过联系kadyovnilasaf@hotmail.com进行反馈,e路人科技收到您的反馈后将及时答复和处理。